国外speaking实践过程拍击:惊现笑料不断,传播跨文化交流真谛

61391 2023-12-23 08:50

“大小”这个词,在科技新闻里,往往能引发一场关于深度学习模型的激烈讨论。今天,我们就来聊聊ResNet18模型的大小,挖掘这个话题背后的有趣故事。

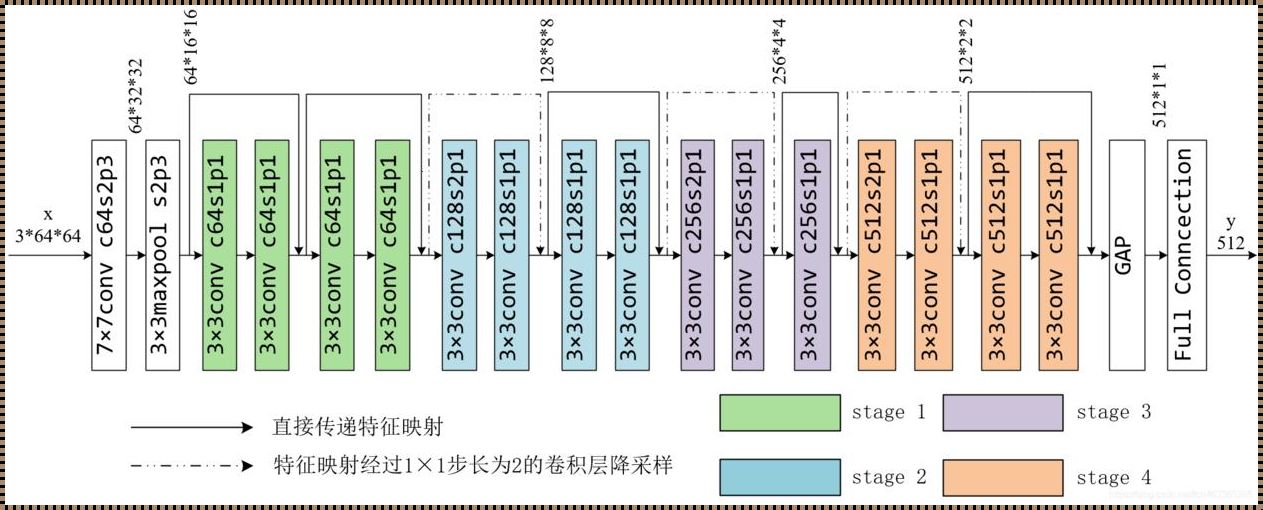

提到ResNet18,相信很多朋友都不会陌生。它是由微软研究院的研究员们提出的一种深度学习模型,凭借其出色的性能和轻量级的特点,在计算机视觉领域获得了广泛应用。那么,这个模型的大小,究竟有何特殊之处呢?

首先,我们要明白,模型的大小并非越大越好。在深度学习领域,模型的大小直接关系到计算资源的需求。一个庞大的模型,虽然可能在性能上有所优势,但同时也意味着更高的计算成本和更长的训练时间。而ResNet18模型,作为轻量级模型,恰到好处地平衡了性能和资源消耗。

那么,ResNet18模型的大小,究竟是多少呢?这里我们可以用一组数据来说明:ResNet18的参数量约为11.7 million,大小约为44.7MB。相比起其他大型模型,如ResNet152的60.4 million参数和229.2MB的大小,ResNet18无疑显得更加“苗条”。

接下来,我们来看看ResNet18模型的大小是如何在科技新闻中发挥作用的。

1. 移动端应用:随着智能手机的普及,移动端应用成为了深度学习技术的重要战场。ResNet18模型的小巧体积,使得它能够轻松部署在手机端,为用户提供实时的图像识别、美颜等AI功能。

2. 边缘计算:在边缘计算场景下,计算资源受限,对模型的大小和性能提出了更高的要求。ResNet18模型凭借其较小的体积和优异的性能,成为了边缘计算设备的理想选择。

3. 资源有限的场景:在一些资源有限的场景,如嵌入式设备、无人机等,ResNet18模型的小巧体积和低功耗特性,使得它能够更好地满足实际应用需求。

当然,我们也不能忽视ResNet18模型在性能上的优势。在ImageNet比赛中的出色表现,使其成为了计算机视觉领域的一个重要里程碑。这也说明了,在模型大小和性能之间,我们可以找到一个完美的平衡点。

然而,ResNet18模型的大小并非一成不变。随着科技的不断发展,研究人员们也在尝试对ResNet18进行压缩和优化,以适应更多场景的应用。例如,通过知识蒸馏、模型剪枝等技术,可以在保持性能的同时,进一步减小模型的大小。

总结一下,ResNet18模型的大小,既体现了科技新闻中关于深度学习模型大小之争的缩影,也反映了我国在计算机视觉领域的研究实力。在未来的发展中,我们期待ResNet18能够发挥更大的作用,为科技新闻带来更多精彩故事。